Nueva versión de la plataforma disponible próximamente, estate atento! 🚀

No sé qué prompt trackear: el verdadero problema de medir visibilidad en IA

Trackear prompts literales en ChatGPT o Gemini no funciona. Cada usuario pregunta distinto. La solución no son más prompts: es medir contextos. Así funciona realmente el GEO.

TL;DR

Nadie pregunta igual a una IA. Trackear un prompt literal te da datos de ese prompt, no de tu visibilidad real.

El problema no es encontrar "el prompt correcto". Es que ese prompt no existe: hay miles de variaciones semánticas para la misma intención.

Los LLMs no responden a palabras, responden a contextos. Eso cambia completamente qué hay que medir.

Si tienes claros tus contextos temáticos, no necesitas grandes volúmenes de prompts — ni para marcas grandes.

La medición tiene que ser diaria. Con cadencias semanales o puntuales no hay muestra suficiente para detectar patrones reales.

La pregunta que paraliza a todo el que empieza con GEO

Imagina que tienes una empresa de tours en Cancún. Llevas semanas escuchando que tienes que medir tu visibilidad en ChatGPT y Gemini. Lo entiendes. Lo aceptas. Abres una herramienta de monitorización de IA y te enfrentas a la primera pantalla: "Añade los prompts que quieres trackear."

Y te quedas parado.

Porque la pregunta que te surge es completamente legítima: ¿qué prompt trackeo exactamente?

¿"Tours en Cancún"? ¿"Mejores excursiones en Cancún"? ¿"Qué tours hacer en Cancún con niños"? ¿"Comparativa de empresas de tours en Cancún"? ¿En español de México, de España, de Argentina? ¿Con registro formal o coloquial?

Un turista alemán que viaja solo no pregunta igual que una familia española con tres hijos. Un millennial que usa Perplexity no escribe igual que un ejecutivo que le pregunta a Copilot entre reuniones.

El problema no es que no sepas elegir el prompt. Es que esa pregunta no tiene respuesta correcta. Y si la tiene, cambia cada día.

Por qué el prompt literal es la unidad de medida equivocada

Venimos del SEO, donde la keyword era el átomo de todo. Encontrabas la keyword, medías su volumen, optimizabas para ella. El sistema era determinista: si escribías bien para esa búsqueda exacta, subías.

Ese modelo funcionaba porque Google hacía matching. Comparaba tu página contra la query del usuario y decidía si coincidían. Las palabras importaban literalmente.

Los LLMs no funcionan así.

Un modelo de lenguaje no compara palabras. Interpreta intención. Construye significado a partir del contexto completo de la pregunta. Y genera una respuesta que sintetiza múltiples fuentes sin necesariamente usar las palabras exactas del usuario.

Esto tiene una consecuencia directa para la medición: el prompt literal que escribe el usuario es casi irrelevante para determinar si tu marca aparece o no. Lo que importa es la intención detrás del prompt. El contexto temático al que pertenece esa pregunta.

El experimento mental del tour

Volvamos al ejemplo de tours en Cancún. Pon diez personas distintas delante de ChatGPT y pídeles que busquen una empresa de tours. Te garantizo diez prompts diferentes:

"¿Qué empresa de tours es mejor en Cancún?"

"Recomiéndame tours para hacer en Cancún"

"Soy de Madrid y voy a Cancún, ¿qué excursiones merecen la pena?"

"Tours Cancún opiniones"

"¿Cuáles son las mejores excursiones con snorkel en la Riviera Maya?"

"Quiero ir a Chichen Itzá desde Cancún, ¿cómo lo organizo?"

Ninguno es igual. Todos pertenecen al mismo contexto temático: turismo organizado en Cancún. Y todos van a generar respuestas donde las mismas empresas tienen probabilidades de aparecer o no.

Si trackeas solo uno de esos prompts, tienes datos de ese prompt. No tienes datos de tu visibilidad.

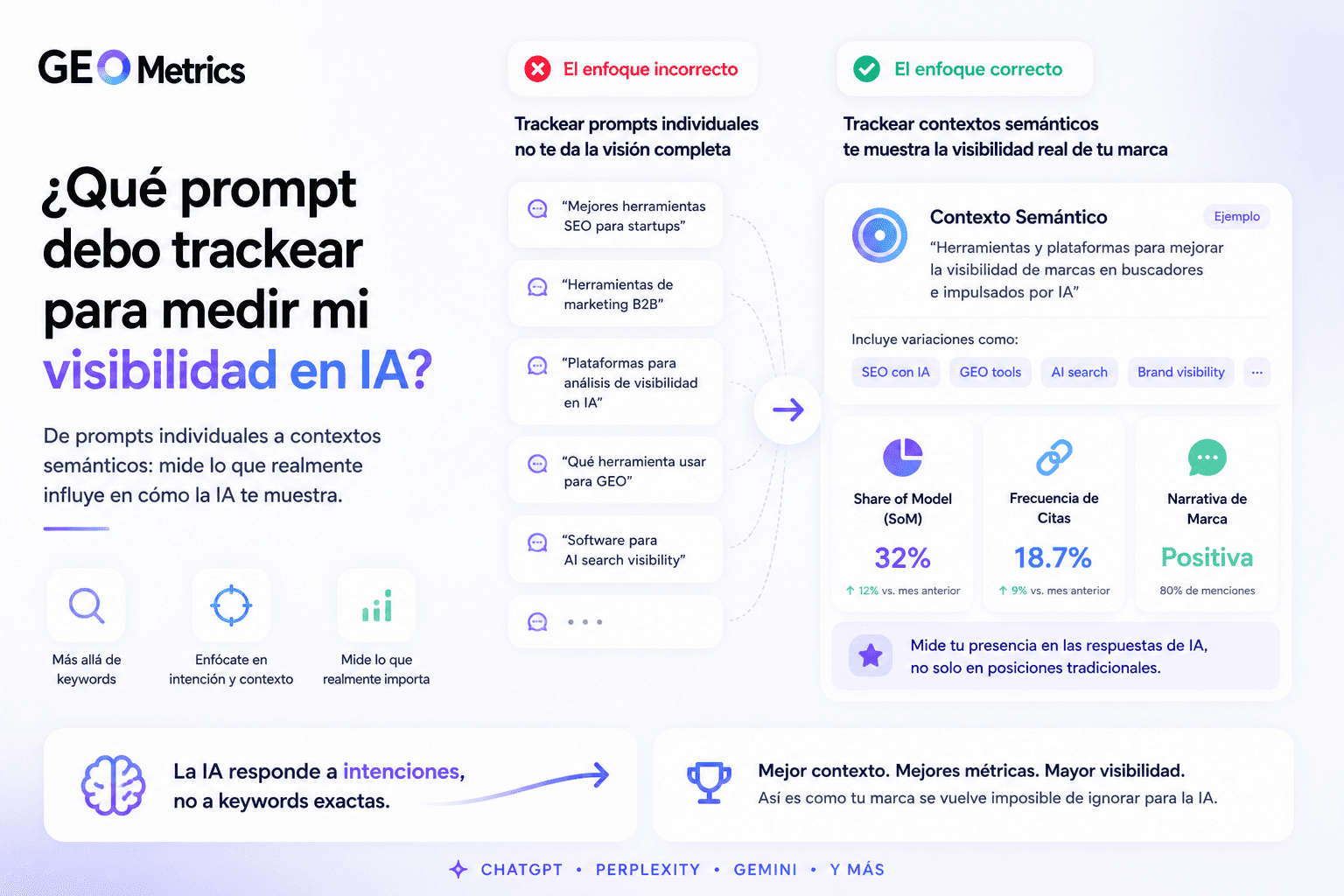

La solución: dejar de pensar en prompts y empezar a pensar en contextos

El cambio conceptual es este: lo que hay que mapear no es cómo pregunta el usuario, sino en qué contextos temáticos quieres que tu marca sea relevante.

Un contexto temático es un territorio semántico. Para la empresa de tours sería algo como: "decisión de compra de excursiones organizadas en el Caribe mexicano." Ese territorio incluye docenas de prompts posibles. Pero todos activan el mismo espacio en el modelo.

Cuando mides por contexto en lugar de por prompt literal, mides algo real: la probabilidad de que tu marca aparezca cuando alguien tiene esa intención, independientemente de cómo la formule.

Cómo funciona la medición por contextos en la práctica

En lugar de definir un prompt exacto, defines el territorio temático y construyes un conjunto representativo de prompts que lo cubren. No necesitas capturar todas las variaciones posibles ni manejar listas interminables. Si tienes claros tus contextos, un conjunto bien definido es más que suficiente — incluso para marcas con presencia en múltiples mercados.

Eso implica tres cosas:

Diversidad semántica. Los prompts deben cubrir distintas formulaciones de la misma intención: preguntas directas, comparativas, búsquedas informacionales, consultas de decisión.

Cadencia diaria. Los LLMs generan respuestas distintas en distintos momentos. Para que la muestra sea estadísticamente representativa, el análisis tiene que ser diario. Con mediciones puntuales o semanales no acumulas suficiente volumen: los patrones no emergen y cualquier conclusión puede ser ruido de un día concreto.

Análisis de patrones, no de ejemplos. Un solo resultado de ChatGPT es anecdótico. La señal real aparece cuando analizas respuestas acumuladas en el tiempo y detectas qué marcas, qué fuentes y qué narrativa aparecen de forma consistente.

Qué métricas tienen valor real cuando mides por contexto

Una vez que el objeto de medición es el contexto y no el prompt, las métricas que importan cambian completamente.

Share of Model (SoM)

El porcentaje de respuestas generadas por un LLM —para tu conjunto de prompts representativos— en las que tu marca aparece mencionada. Es el equivalente al Share of Voice, pero aplicado al espacio de la IA.

Para la empresa de tours: si apareces en 23 de cada 100 respuestas que ChatGPT genera para consultas sobre excursiones en Cancún, tu Share of Model en ese contexto es del 23%. Eso es una métrica accionable. Saber que "no apareciste en este prompt concreto hoy" no lo es.

Frecuencia de citación

Cuántas veces tu dominio aparece como fuente referenciada en las respuestas. Que te mencionen es una señal. Que te citen como fuente de autoridad es una señal de mayor calidad: significa que el modelo considera tu contenido como fundamento de la respuesta, no solo como referencia tangencial.

Narrativa construida sobre tu marca

Qué historia está contando la IA sobre tu categoría y tu posicionamiento dentro de ella. Dos empresas con el mismo Share of Model pueden tener narrativas radicalmente distintas: una aparece como referencia líder, la otra como opción secundaria. Esa diferencia no la captura ningún prompt aislado.

Presencia competitiva

Quién ocupa el espacio que debería ser tuyo. Tu Share of Model solo tiene valor relativo: lo que importa es cuánto porcentaje de las respuestas se lo está llevando tu competidor directo en el mismo contexto temático.

El error de los datos de una sola sesión

Hay un hábito que se está extendiendo y que produce conclusiones falsas: abrir ChatGPT, escribir el nombre de tu empresa, leer la respuesta y sacar conclusiones sobre tu visibilidad.

Ese ejercicio no mide nada útil.

Los LLMs son sistemas probabilísticos. La misma pregunta, en la misma plataforma, en dos sesiones distintas, puede generar respuestas diferentes. Las variaciones dependen del contexto de la conversación, del modelo exacto que está corriendo en ese momento y de las actualizaciones recientes del sistema.

Tomar decisiones estratégicas sobre tu visibilidad basándote en una respuesta puntual es como juzgar el rendimiento de un equipo basándote en un partido aleatorio. Puedes tener razón por casualidad. Pero no tienes datos.

La medición fiable requiere consistencia: mismo conjunto de contextos, cadencia diaria, análisis de patrones sobre respuestas acumuladas. Solo entonces la señal emerge del ruido.

Por qué esto es especialmente crítico en mercados hispanohablantes

El problema del prompt se amplifica en español.

Las variaciones semánticas en castellano son significativamente mayores que en inglés por razones obvias: el español de México, Argentina, España, Colombia y Chile tiene diferencias de vocabulario, registro y expresión que afectan directamente cómo los usuarios formulan sus preguntas a una IA.

Un usuario en Madrid pregunta "¿Cuáles son las mejores agencias de viajes?". Un usuario en Buenos Aires pregunta "¿Qué agencias de turismo me recomendás?". Dos formulaciones de la misma intención con vocabulario completamente distinto.

Las herramientas globales de monitorización están construidas sobre datos predominantemente en inglés. Sus conjuntos de prompts, sus benchmarks y sus patrones de análisis no capturan las particularidades del español en sus distintas variantes.

Esto no es un detalle menor. Es la diferencia entre medir tu visibilidad real en tu mercado o medir ruido con acento extranjero.

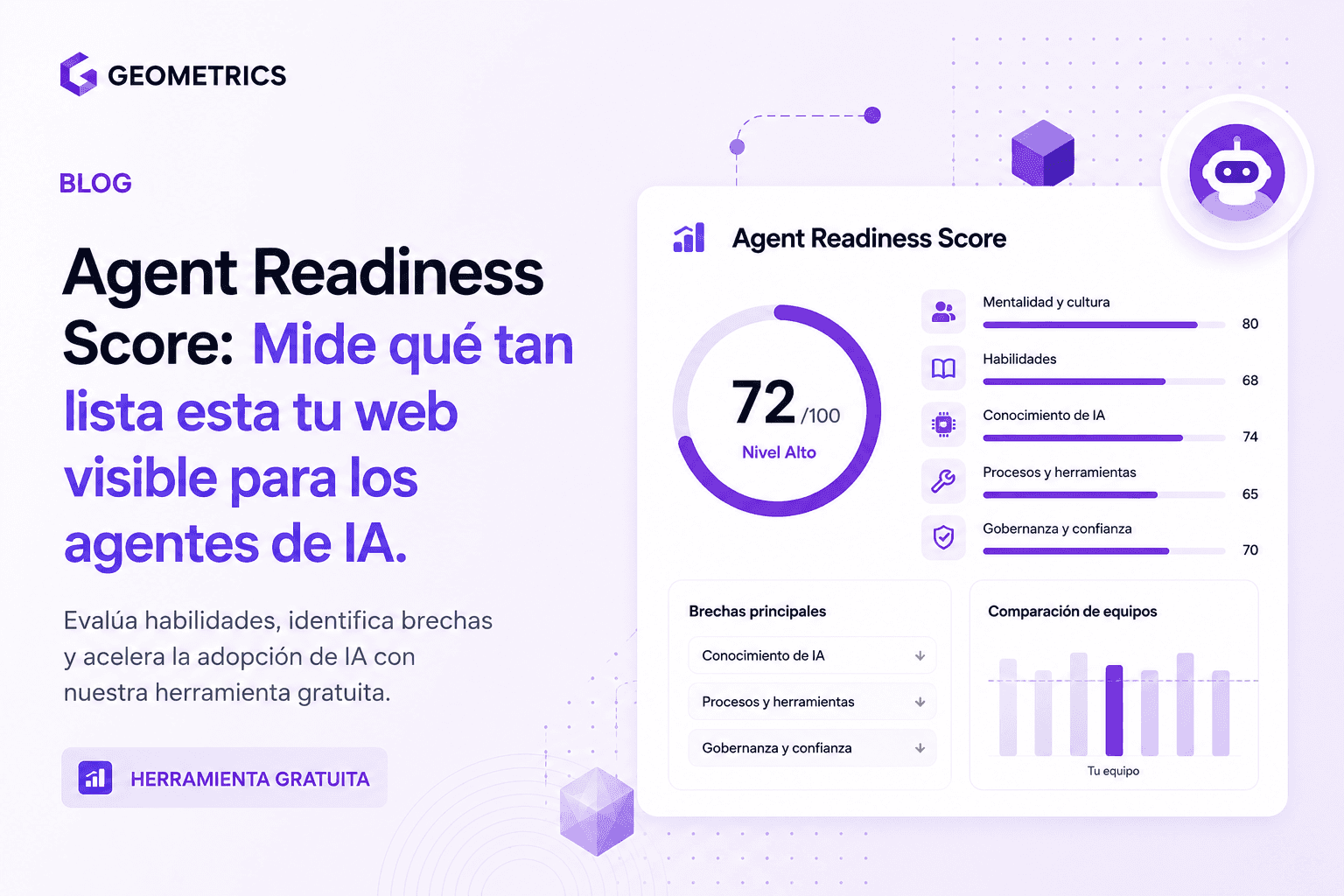

Cómo aborda GEO Metrics el problema del prompt

GEO Metrics parte de este diagnóstico: trackear prompts literales no escala y no produce datos fiables. El objeto de medición tiene que ser el contexto temático.

La plataforma construye conjuntos de prompts representativos por contexto, los analiza de forma diaria en ChatGPT, Gemini, Perplexity y Copilot, y mide Share of Model, frecuencia de citación, narrativa de marca y presencia competitiva con la consistencia que hace falta para que los patrones sean reales.

El resultado no es saber qué pasó con un prompt hoy. Es saber cómo evoluciona tu visibilidad en los contextos que importan para tu negocio, qué fuentes está usando la IA para construir sus respuestas sobre tu categoría y qué está haciendo tu competencia en ese mismo espacio.

GEO Metrics no te dice qué prompt escribir. Te dice si estás ganando o perdiendo el territorio semántico que le importa a tu negocio.

Preguntas frecuentes sobre prompts, contextos y visibilidad en IA

¿Cuántos prompts necesito para medir mi visibilidad en IA de forma fiable?

Menos de los que crees, siempre que tengas claros tus contextos temáticos. Si sabes en qué territorios quieres que tu marca sea relevante, no necesitas cubrir todas las variaciones posibles: necesitas prompts representativos de cada contexto. Incluso para marcas grandes, un conjunto bien definido por contexto es suficiente para producir patrones fiables. El problema no es la cantidad de prompts. Es no tener claro el contexto antes de definirlos.

¿Con qué frecuencia debo analizar mis contextos para detectar cambios reales?

La cadencia tiene que ser diaria. Es la única forma de acumular suficientes respuestas para que la muestra sea estadísticamente representativa. Con mediciones semanales o puntuales no tienes volumen suficiente: los patrones no emergen y cualquier conclusión que saques puede ser ruido de un día concreto. GEO Metrics analiza los contextos de forma diaria precisamente por eso — para que los datos que ves reflejen tendencias reales, no variaciones aleatorias.

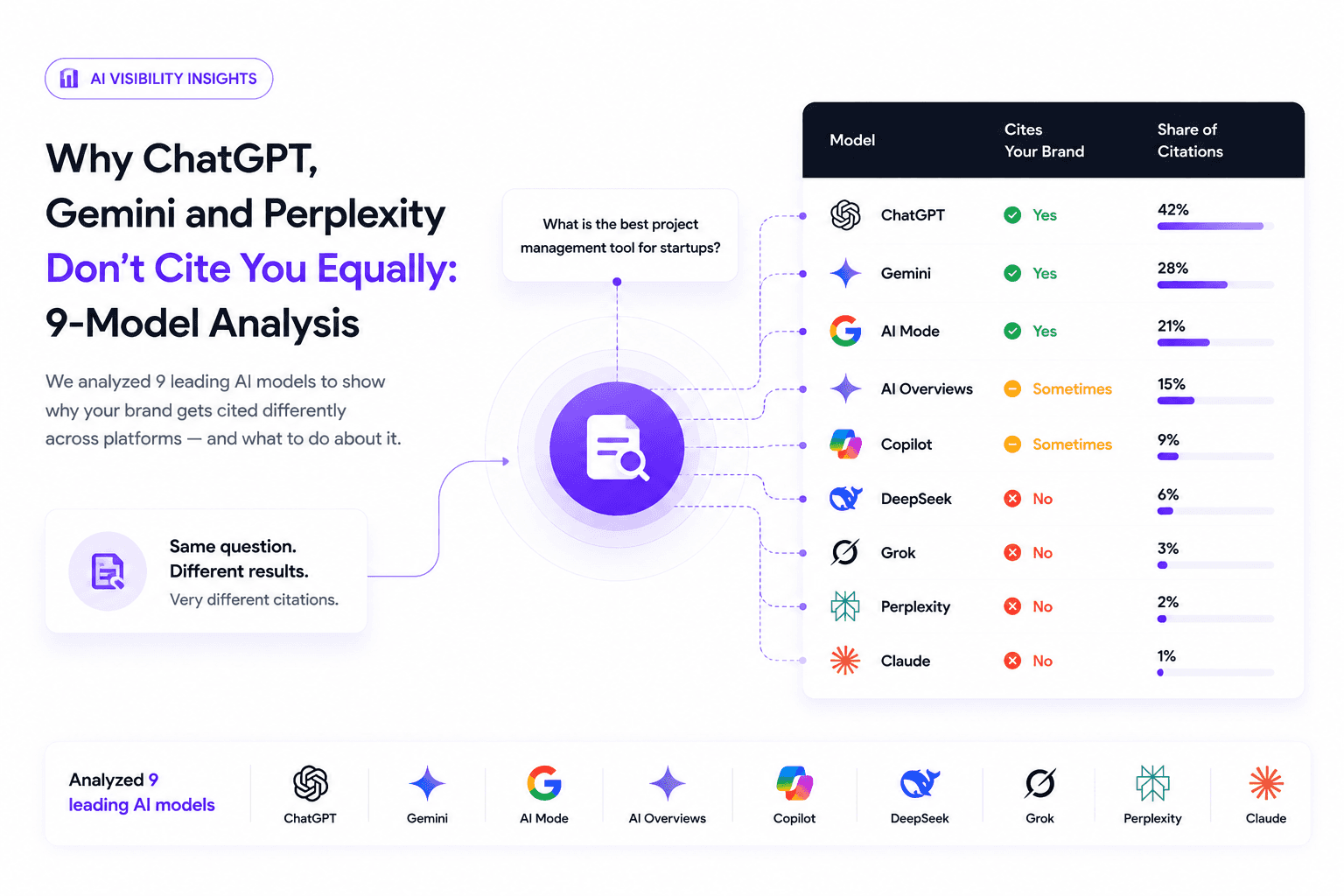

¿Qué diferencia hay entre medir en ChatGPT y medir en Gemini o Perplexity?

Cada plataforma tiene sesgos de citación distintos, fuentes preferidas y patrones de respuesta diferentes. Tu Share of Model puede ser del 30% en Perplexity y del 8% en ChatGPT para el mismo contexto temático. Medir en una sola plataforma da una imagen parcial. La visibilidad real en IA es el agregado de tu presencia en los motores de respuesta que usa tu audiencia.

¿Qué hago si la IA menciona mi marca con información incorrecta?

Es lo que se conoce como alucinación de marca: el modelo genera datos falsos sobre tu empresa con el mismo tono de confianza que usa para información correcta. La estrategia de mitigación pasa por publicar contenido con datos precisos, estadísticas actualizadas y fuentes verificables que reduzcan el margen creativo del modelo y lo anclen a los hechos reales de tu negocio.

¿Puedo mejorar mi visibilidad en IA sin cambiar mi estrategia de contenidos?

La visibilidad en IA depende en gran medida de qué contenido indexan los modelos y qué fuentes consideran autoritativas. En la mayoría de los casos, mejorar el Share of Model requiere ajustes en la estrategia de contenidos: más densidad semántica en los temas relevantes, mayor autoridad percibida y presencia en las fuentes que los LLMs priorizan para citar.

¿Quieres ver cuál es tu Share of Model real en ChatGPT, Gemini y Perplexity para los contextos que importan a tu negocio?

Solicita una demo en trygeometrics.com/contact y te mostramos los datos reales de tu visibilidad — sin teoría y sin prompts aleatorios.

Experto en GEO y AEO enfocado en hacer que las marcas sean visibles dentro de las respuestas generadas por AI. Dirige GEO Metrics, midiendo cómo modelos como ChatGPT y Gemini citan, clasifican y describen marcas. Su trabajo ayuda a las empresas a pasar de las clasificaciones SEO a la verdadera visibilidad en la búsqueda impulsada por AI.

Lee más artículos

Aprende estrategias prácticas, flujos de trabajo probados y consejos de expertos para ayudar a que tu marca prospere.

¡Suscríbete a la newsletter de GEO Metrics!

Recibe consejos de expertos, actualizaciones y análisis inteligentes directamente en su bandeja de entrada.